Roboterassistent »3D-Kosyma« lernt, menschliche Gesten zu verstehen

Ein am Fraunhofer IOF mitentwickelter Roboterassistent erlaubt künftig die Interaktion zwischen Mensch und Maschine basierend auf menschlicher Gestik. Das System »3D-Kosyma« soll u. a. in der Automobilherstellung zum Einsatz kommen und dort neue Standards in der Qualitätssicherung etablieren.

Roboter interpretiert menschlich Bewegung mittels 3D-Sensor

Peter Kühmstedt steht in seinem Labor am Fraunhofer IOF in Jena, neben ihm lehnt ein unbearbeitetes Karosseriebauteil: eine Autotür. Sie weist eine für das menschliche Auge kaum sichtbare Beschädigung auf – ihre Oberfläche ist durch eine Delle deformiert. Peter Kühmstedt, Abteilungsleiter für Bildverarbeitung und Sensorik am Institut, zeigt mit seinem Finger auf die Stelle, an der er den Schaden in der Außenhaut der Tür vermutet. Ein nahestehender Roboter mit 3D-Sensoren erwacht daraufhin zum Leben. Er erkennt die Fingerposition des Forschers und folgt der angezeigten Richtung.

An der fraglichen Stelle beginnt das komplexe Messsystem mit seiner Untersuchung und führt 3D-Messungen durch. Die mit dem Sensor erfassten Daten verarbeitet das Messsystem anschließend und gleicht sie mit fehlerfreien Oberflächen ab, um Größe und Umfang des Defektes am Bauteil zu erfassen.

Und tatsächlich: Das System findet die Delle und markiert den Bereich, in dem sich der Schaden befindet, mit einem Lichtsignal. Das ist »3D-Kosyma« – ein mobiles, robotergestütztes Prüfsystem. Es lässt sich basierend auf der Interaktion zwischen Mensch und Maschine in technischen Produktions- und Wartungsumgebungen einsetzen.

Prüfsysteme zur Qualitätssicherung einfacher und effizienter gestalten

Der neue Roboterassistent verfolgt dabei vor allem ein Ziel: Er soll Prüfmessungen, wie sie in jeder industriellen Produktion nötig sind, einfacher und effizienter gestalten und damit die Qualitätssicherung in der Industrie nachhaltig fördern.

»Uns ging es darum, einen möglichst niedrigschwelligen Umgang zwischen dem Menschen und dem Roboter in der Qualitätssicherung umzusetzen«, beschreibt Dr. Peter Kühmstedt den Ansatz des Projektes. Projektleiter Dr. Tilo Lilienblum vom Kooperationspartner INB Vision AG ergänzt: »Ganz intuitiv kann der Mensch auf ein Teil zeigen. Der Roboter folgt der Geste und vermisst das Bauteil.«

Entwicklung abgeschlossen, Gespräche mit Industriepartnern laufen

Nun ist die erste Entwicklungsphase des Roboterassistenten abgeschlossen und das System soll seinen Weg in die Wirtschaft finden. Dazu werden derzeit Gespräche mit Partnern aus Industrie und Wirtschaft geführt. Eine hierfür passende Gelegenheit bot sich im vergangenen Oktober: Das Automotive Cluster Ostdeutschland sowie das BMW Werk Leipzig luden zum Technologie-Pitch nach Leipzig ein. Mit dabei: Vertreterinnen und Vertreter des Projektes »3D-Kosyma«.

Ihr Vortrag traf auf positive Resonanz, in deren Folge BMW nun Gespräche mit dem Projektteam über mögliche Anwendungsszenarien in der Automobilproduktion führt. Detaillierte Abstimmungen in Bezug auf ein – auf die Bedürfnisse des Werkes abgestimmtes – Prüfsystem sind in naher Zukunft vorgesehen.

Fraunhofer IOF und INB Vision bündeln Kompetenzen im Bereich 3D-Erfassung

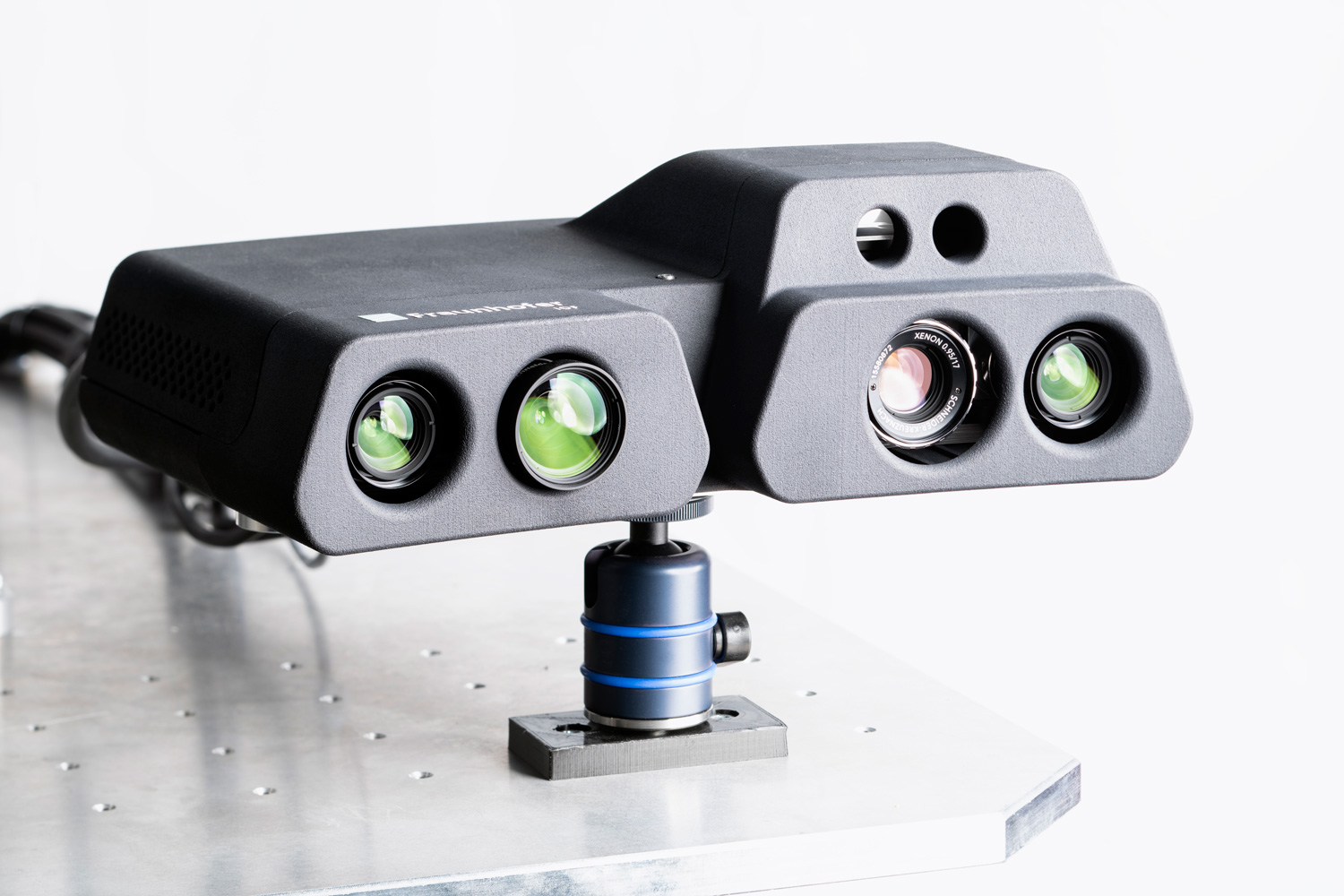

Der Roboterassistent besteht aus mehreren Komponenten: Das Fraunhofer IOF bringt in das neuartige System seine Kompetenzen in der 3D-Erfassung großflächiger Messszenarien ein. Ein am Fraunhofer IOF entwickelter 3D-Sensor überblickt die ihm gebotene Szene und registriert sowohl die Gestik eines Menschen als auch die präsentierten (Bau-)Teile. Sobald der Roboter über diesen 3D-Sensor erkennt, dass ein Mensch auf einen Gegenstand zeigt, wird ein separater Roboterarm mit einem zweiten 3D-Sensor der Firma INB Vision AG an dieses Bauteil herangefahren.

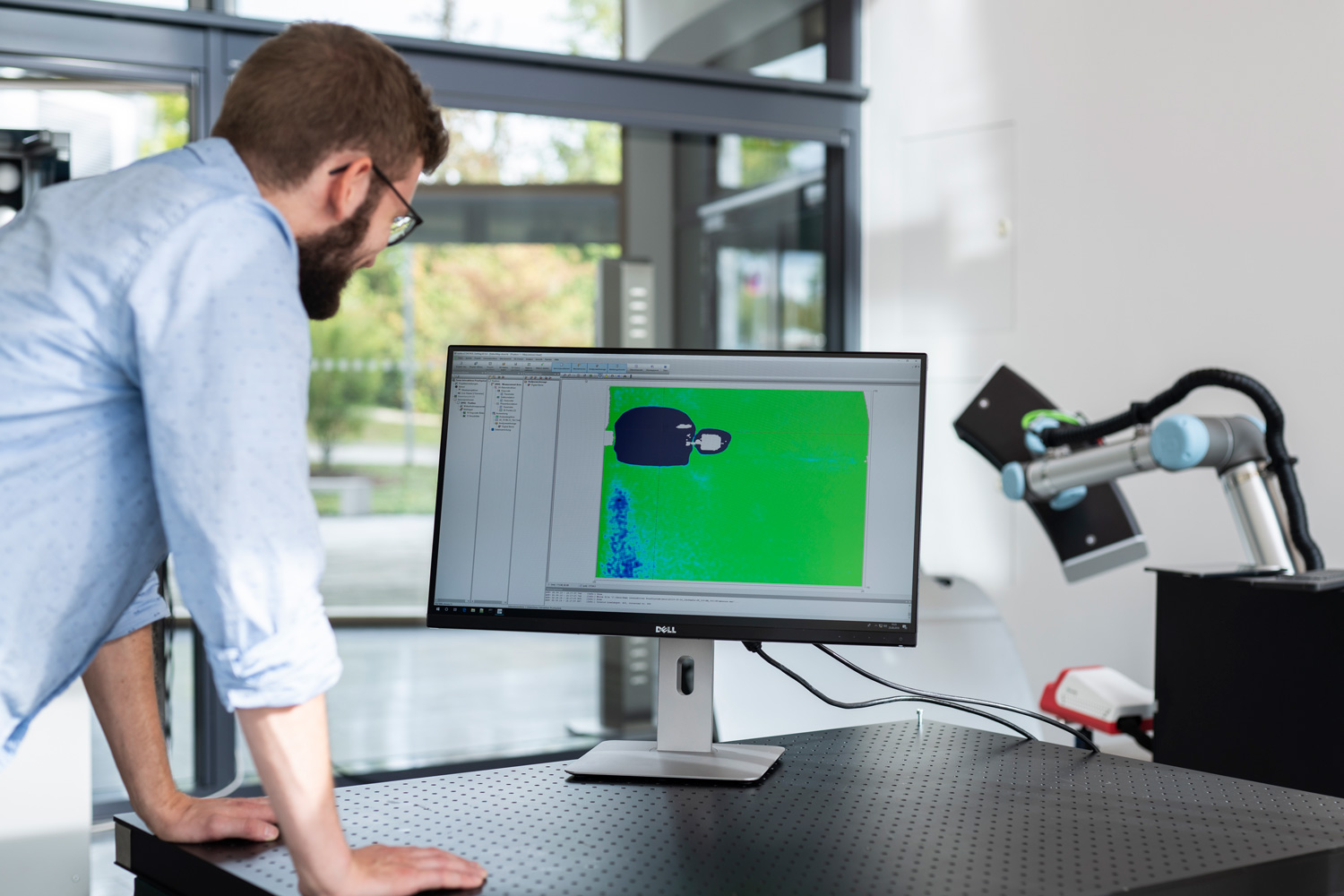

Der zweite 3D-Sensor übernimmt anschließend den Prüfprozess. Auf diese Weise kann die 3D-Oberfläche des Bauteils genau vermessen werden. Mit den gewonnenen Informationen kann das System kleinste lokale Abweichungen von der gewünschten Oberflächenform – den gespeicherten Soll-Daten – erkennen und visuell anzeigen. Ein Mitarbeitender wird so auf die Abweichung aufmerksam und kann an einem separaten Monitor sehen, wie gravierend der Fehler ist. Daraufhin kann er eine Entscheidung für das weitere Vorgehen im Fertigungsprozess treffen.

Der Anspruch des Projektes »3D-Kosyma« ist es, ein kollaboratives ortsflexibles Prüfsystem zu entwickeln, das die Mensch-Maschine-Interaktion in der 3D-Qualitätssicherung unterstützt. Das System wird derzeit vorwiegend für Prozesse der Automobilindustrie weiterentwickelt, kann aber auch in anderen Bereichen des Maschinen- und Anlagenbaus eingesetzt werden. Wo immer eine undefinierte Situation in der Fertigung auftaucht, kann das System Gesten oder Signale des Menschen in eine passende Aktion des Roboters umsetzen.

An dem Projekt sind neben dem Fraunhofer IOF auch das Fraunhofer-Institut für Fabrikbetrieb und -automatisierung IFF in Magdeburg, die INB Vision AG Magdeburg, die Softwareentwickler 3plusplus GmbH aus Suhl und die Berliner Innovationsberater Gitta GmbH beteiligt.

Hintergrund: Verbundprojekt »3Dsensation«

»3D-Kosyma« ist Teil des Verbundprojektes »3Dsensation« – eines von zehn Konsortien aus dem Förderprogramm »Zwanzig20 – Partnerschaft für Innovation« des Bundesministeriums für Bildung und Forschung.

Die Allianzpartner von »3Dsensation« verfolgen das Ziel, Maschinen durch innovative 3D-Technologien in die Lage zu versetzen, komplexe Szenarien visuell zu erfassen und zu interpretieren. Das Konsortium arbeitet an den Grundlagen für eine sichere und effiziente Interaktion von Mensch, Maschine und Umwelt in den zentralen Lebens- und Arbeitsbereichen Produktion, Gesundheit und Mobilität.

Letzte Änderung: